谷歌于今日宣布推出Gemini1.5。Gemini1.5的建立基础是谷歌基础设施和基础模型开发的研究与工程创新,建立在谷歌对MoE和 Transformer的领先研究之上。通过新的专家混合架构的训练,Gemini1.5的服务更加的高效。Transformer在传统意义上所充当的是一个大型的网络神经,而MoE模型被细分为更小的神经网络。

谷歌在模型架构方面进行了创新。Gemini1.5能够针对复杂的任务保质保量的快速学习,同时还能够更加高效的服务和训练。这些效率使得谷歌团队在培训、交付更高级的Gemini版本和迭代方面的速度更快,同时还在不断的努力进行进一步的优化。

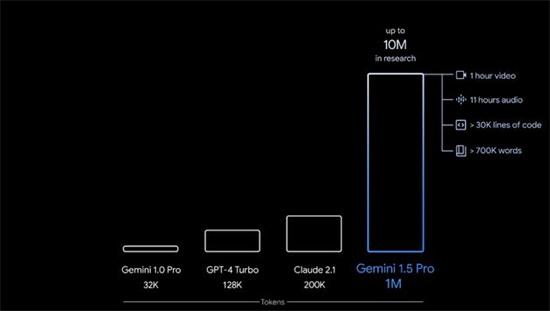

谷歌通过一系列的机器学习创新将1.5 Pro上下文窗口的容量增加了,与Gemini1.0最初的32000个token相比,远远高出了很多。在生产环境当中,该大模型可运行的token多达100万个。也就是说1.5 Pro可以一次性处理的信息量非常大,包括11个小时的音频、一个小时的视频、超过70万个单词或3万行代码的代码库。谷歌在研究的过程当中,还成功的进行了1,000万个token的测试。

Gemini1.5 Pro可以在给定的提示内针对大量的内容进行无缝的分类、总结和分析。比如402页有关阿波罗11号登月任务的记录,Gemini1.5 Pro可以对整个文档当中的所有细节事件和对话进行推理分析。Gemini1.5 Pro可以实现对阿波罗11号登月任务402页记录当中所有的好奇细节识别、推理和理解。

Gemini1.5 Pro针对包括视频在内的不同模式,可以执行高度复杂的推理和理解任务。比如如果给Gemini1.5 Pro一部长达44分钟的无声电影,该模型就可以将电影中的事件和情节点全部准确地分析出来,甚至能够将电影当中一些很容易被忽略的小细节推理出来。

Gemini1.5 Pro在执行更相关的问题解决任务时,可以跨越较长的代码。当给出的代码提示超过10万行时,Gemini1.5 Pro针对不同部分的工作原理进行推理,并且给出相对合理的有用的修改和解释。